本文探讨 AI 网关如何应对 API 网关领域的关键挑战,揭示其如何释放人工智能的全部潜能,将技术瓶颈转化为发展机遇。

引言

在人工智能技术快速演进的时代背景下,大型语言模型(LLMs)和 AI 智能体已成为各类应用的核心组件,引发 AI 相关 API 流量的指数级增长。随着企业将 AI 深度整合至业务流程,如何有效管理和优化 AI 驱动的交互正成为新的技术挑战。

以深度求索(Deepseek)为代表的开源 LLM 技术兴起,使得企业不仅能够使用 OpenAI、Azure 等 SaaS 化 LLM 服务,更可在私有化环境中部署 LLM 模型,形成混合云架构。这一技术范式迁移带来了数据安全、多 LLM 适配管理、性能优化和可靠性保障等系列挑战,传统 API 网关向专业化 AI 网关的演进势在必行。

作为 Apache APISIX 项目的 PMC 成员,我在开源社区也深切感知到这一技术趋势和市场需求。

LLM 和 AI 代理的崛起

LLM 和 AI 智能体通过增强自然语言理解、生成和决策能力,正在重塑企业运营模式。典型应用场景包括:

- 智能客服自动化:AI 聊天机器人和虚拟助手正在替代传统客服流程

- 代码生成与软件开发:GitHub Copilot、DeepSeek 等 AI 工具辅助开发者编程和调试

- 金融法律分析:AI 模型协助专业人士解析法律合同与财务报表

- 内容生成引擎:AI 驱动的营销文案、新闻稿件和技术文档自动生成

这场技术变革导致应用系统对 AI 服务的调用量呈爆发式增长。AI 与业务流程的深度集成已成为企业保持竞争优势的关键要素,这要求技术团队必须重构原有的 API 管理策略。

开源 LLM 驱动的混合云架构兴起

以 Deepseek 为代表的开源 LLM 技术,使企业能够在自有基础设施中部署 AI 模型。这种能力催生了混合云架构的普及,即公有云 SaaS 化 LLM 服务与私有化部署相结合的技术方案。这种架构虽提供了灵活性和可控性,但也带来了混合环境管理、跨平台性能一致性保障和安全体系构建等复杂度提升的技术挑战。

AI 驱动型 API 流量管理痛点

AI 服务与业务系统深度集成主要面临以下技术挑战:

1. 数据安全治理

将敏感信息传输到外部 LLM 提供商引发了关于数据隐私、法规合规性(如 GDPR 和 CCPA)以及潜在数据泄露的担忧。企业必须实施强大的安全措施,例如:

- 数据泄露防控:在将提示词发送到外部 AI 服务之前进行数据屏蔽和删减。

- 访问控制体系:基于角色的访问控制(RBAC),以限制对敏感 AI 功能的访问。

- 数据加密:对传输中和静态数据进行加密,以防止未授权访问。

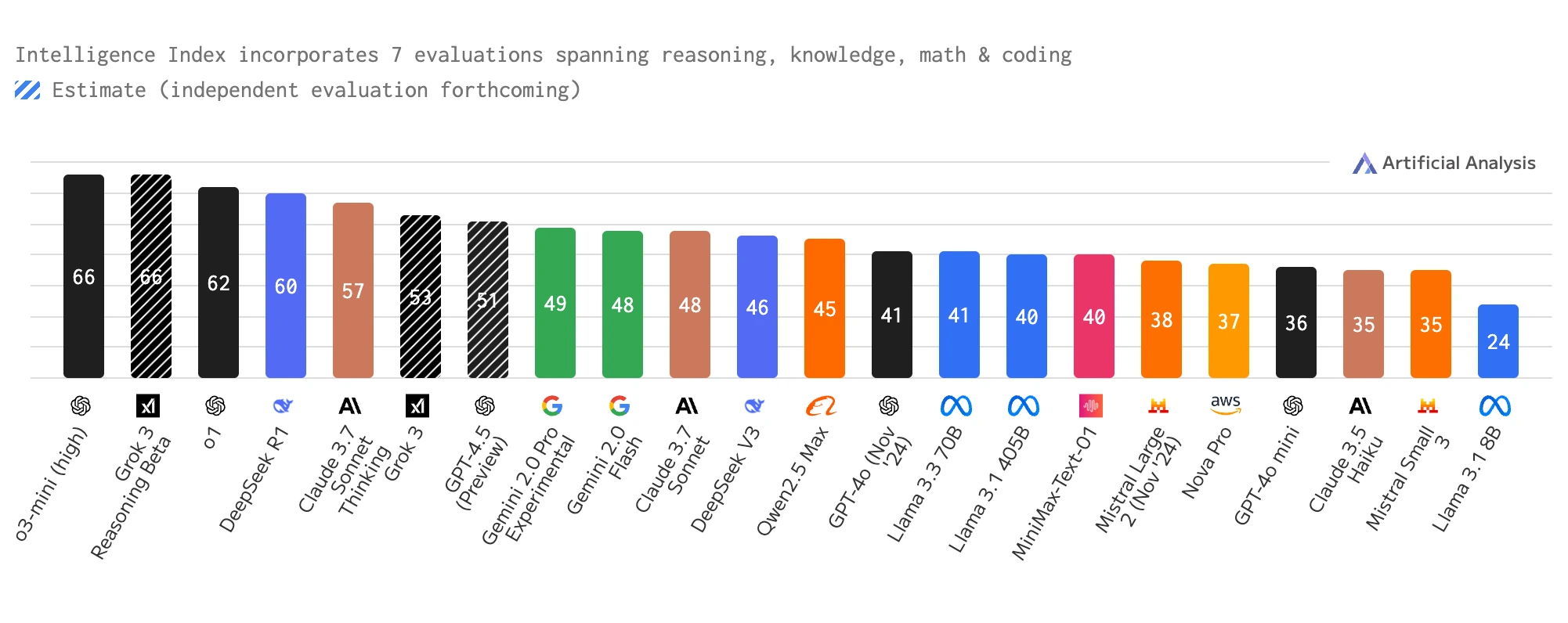

2. 多模型适配与管理

不同的 AI 任务需要特定于特定领域的 LLM,如代码生成、UI设计、法律分析、金融建模。企业需建立:

- 智能路由机制:根据任务特征动态为 AI 请求选择最优模型

- 供应商切换能力:基于成本、可用性和延迟指标进行服务商动态切换

- 多模型监控体系:实现跨模型性能监控与质量一致性保障

3. 性能和成本优化

LLM 推理的高算力消耗带来显著成本压力,AI 网关需通过以下技术手段实现资源优化:

• 响应缓存机制:通过 AI 结果缓存减少重复 API 调用 • 令牌计量体系:精准跟踪和控制 API 使用量 • 负载均衡策略:跨供应商的智能流量调度以平衡响应速度与成本

4. 服务可靠性保障

当 AI 系统成为业务核心组件时,高可用架构设计需包含:

- 容错重试机制:在 LLM 服务异常时自动切换备用节点,减少因服务中断导致的停机时间

- 熔断保护策略:流量洪峰时实施服务熔断,防止在高峰需求期间 AI 服务过载

- 智能路由优化:基于实时延迟指标选择最优 LLM 实例节点

AI 网关的作用

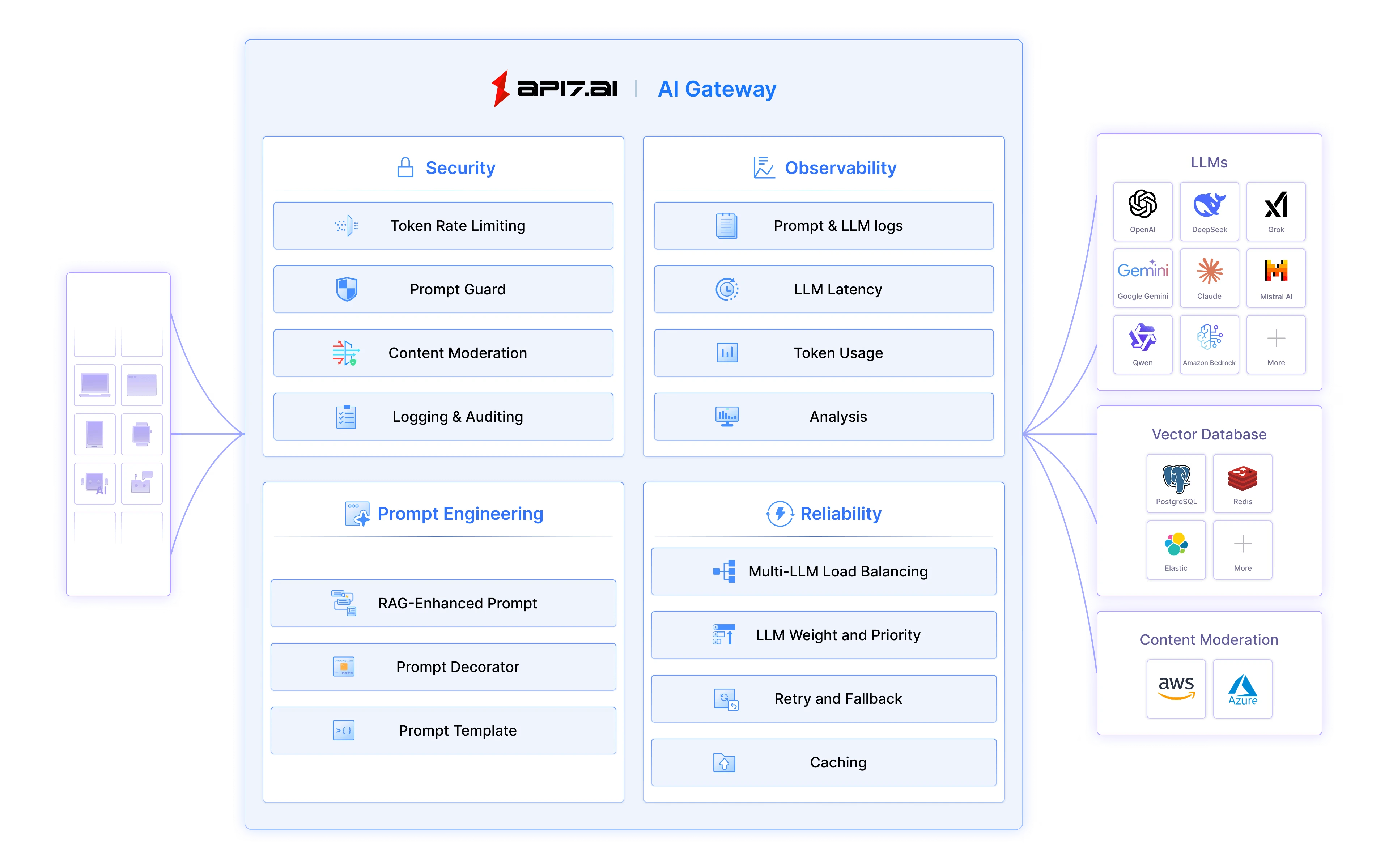

为应对上述挑战,AI 网关应运而生。AI 网关通过纳入专为 AI 应用和 LLM 场景设计的功能,扩展了传统 API 网关的功能。它作为连接 AI 基础设施和服务的统一端点,提供对应用程序和模型之间 AI 流量的全面控制、安全性和可观测性。

成熟的 AI 网关应具备以下关键能力:

1. 安全

- 基于令牌的速率限制:基于 Token 实现 API 调用频次管控,防止资源滥用

- 提示词安全过滤:对输入提示词进行敏感内容检测,防范数据泄露风险

- 内容审核:实时监测 AI 输出内容,拦截违法违规信息

2. 可观测性

- 用量追踪:细粒度 Token 消耗监控,支撑成本分析与容量规划

- 审计日志:完整记录 AI 交互轨迹,满足合规审计需求

- 实时监控:跟踪 LLM 响应时间、错误率和 API 使用模式等关键 SLA 指标,以确保达到理想的性能状态

3. 提示词工程

- 检索增强生成(RAG):通过检索增强生成技术提升响应准确率

- 提示词装饰器和模板:标准化提示词模板实现跨场景最佳实践复用

- 动态上下文注入:基于会话上下文智能补充查询语义

4. 可靠性

- 多模型负载均衡:智能分发请求至最优 LLM 实例

- 重试与降级机制:在 AI 服务异常时实现优雅降级

- 流量分级调度:保障高优先级任务的服务质量(QoS)

总结

AI 与业务系统的深度整合既是机遇也是挑战。当 AI 服务主要通过 API 进行交互时,构建专用的 AI 网关成为技术架构演进的关键路径。通过在传统 API 网关基础上叠加 AI 专属能力,企业能够实现:

✅ 安全闭环:构建从数据输入到内容输出的全链路防护

✅ 成本可控:通过 Token 计量与缓存机制优化资源利用率

✅ 体验升级:基于智能路由策略保障毫秒级响应体验

✅ 运维提效:统一监控面板实现多模型服务治理

随着 AI 技术持续演进,AI 网关将逐步成为智能时代的技术基座。率先构建 AI 网关能力的企业,将在保障 AI 服务可靠性的同时,获得技术架构的长期竞争优势,为业务创新提供持续动能。